AMIE 实现了愿景:一个用于多模态诊断对话的 AI 助手

我们分享了首个多模态对话诊断 AI 代理的演示,即多模态 AMIE。

快速链接

基于语言模型的 AI 系统,如 Articulate Medical Intelligence Explorer (AMIE,我们最近在《自然》杂志上发表的研究诊断对话 AI 代理) 在进行文本医学诊断对话方面展现了相当大的潜力,但它们如何在对话中整合多模态数据这一关键方面仍未得到探索。 即时通讯平台是一种流行的通信工具,可以用来通过静态多模态信息(如图片和文档)来丰富讨论,这种工具在医疗环境中也有应用。这种讨论多模态信息的特性在医学中尤为重要,因为调查和测试是有效护理的关键,可以为诊疗过程提供重要信息。 因此,大语言模型能否进行包含复杂信息类型的诊断临床对话,是一个重要的研究领域。

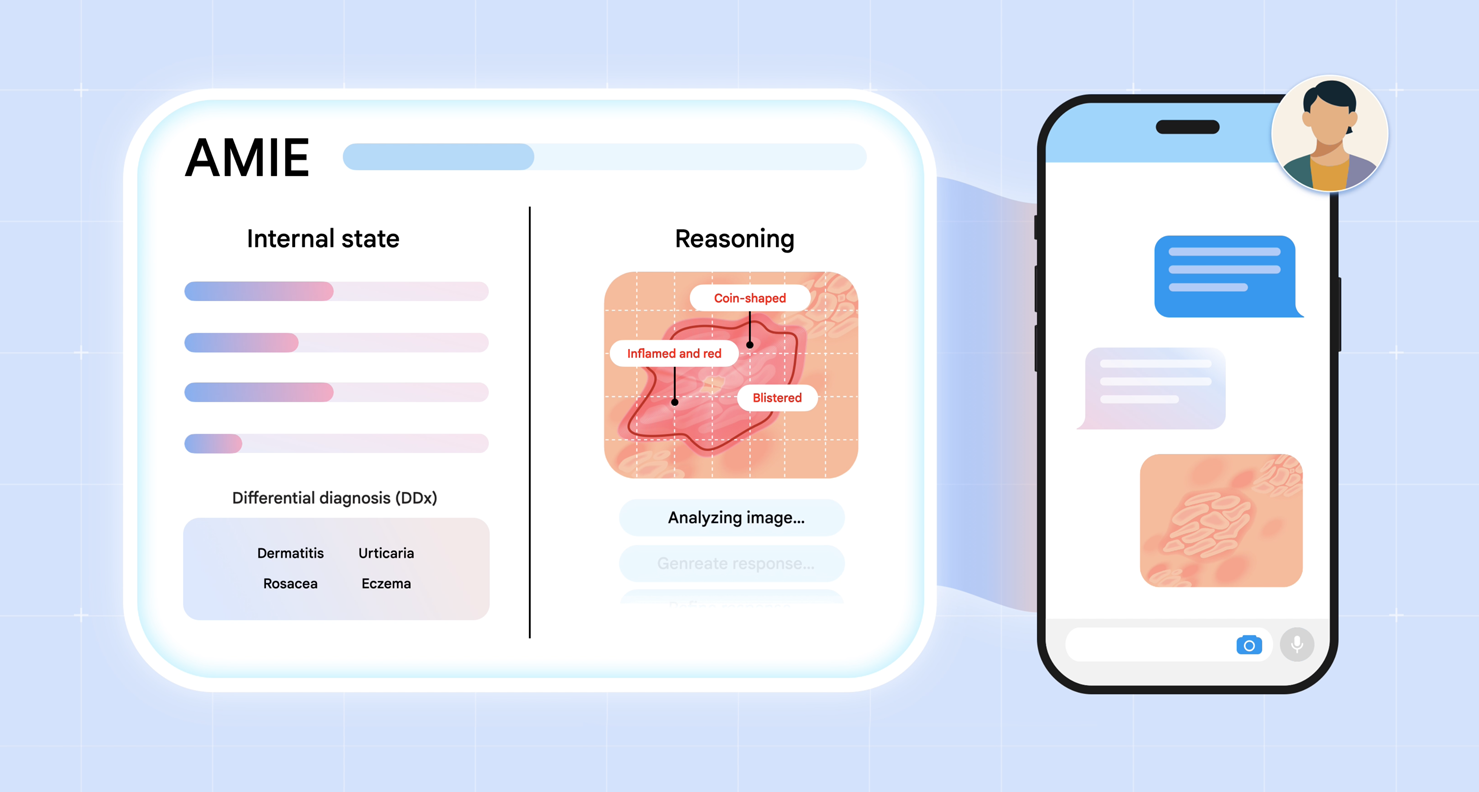

在我们的新研究中,我们进一步开发了 AMIE,使其能够在临床对话中智能获取、解读和分析视觉医学信息,从而实现准确的诊断和治疗方案。为此,我们在多模态 Gemini 2.0 Flash 的基础上构建了一个智能系统,该系统能根据对话阶段及其对诊断的不确定性变化优化响应。 这种结合使得病史采集过程能够更好地模拟现实世界临床实践中常见的病史采集结构。

通过专家评估采用全球医疗教育中通用的客观结构化临床考试(OSCEs),我们对比了 AMIE 与初级保健医生的表现,并评估了他们在多种患者情境中的行为。此外,初步实验表明,整合最新基础模型可以显著提升 AMIE 的能力。

我们介绍多模态 AMIE:我们的诊断对话 AI,能够在临床诊断对话中智能获取、解读和分析视觉医学信息。通过结合多模态 Gemini 模型和我们的状态感知推理框架,我们将多模态感知和推理集成到 AMIE 中。

提升 AMIE 的多模态推理能力

我们为 AMIE 引入了两个关键的进展。首先,我们开发了一个多模态、状态感知的推理框架。这使得 AMIE 能够根据其内部状态调整其响应,反映对话中患者的相关知识,并有效收集信息以得出适当的诊断(例如,通过请求多模态信息(如皮肤照片)来解决知识缺口)。 其次,为了帮助我们更好地设计 AMIE 系统,我们创建了一个对话评估的模拟环境。在这个环境中,AMIE 会根据多模态场景与虚拟患者对话,这些场景基于真实世界的数据集构建而成,例如 SCIN 皮肤科图像数据集。

模仿经验丰富的临床医生进行病历分析:基于状态的推理

真实的临床诊断对话遵循结构化但灵活的模式。医生会系统地收集信息,并根据这些信息逐步提出可能的诊断。他们可以策略性地请求和分析各种多模态数据(例如皮肤照片、实验室结果或心电图测量值)以获取更多信息。基于这些新证据,他们会提出适当的问题来澄清信息空白点,并确定诊断可能性的范围。

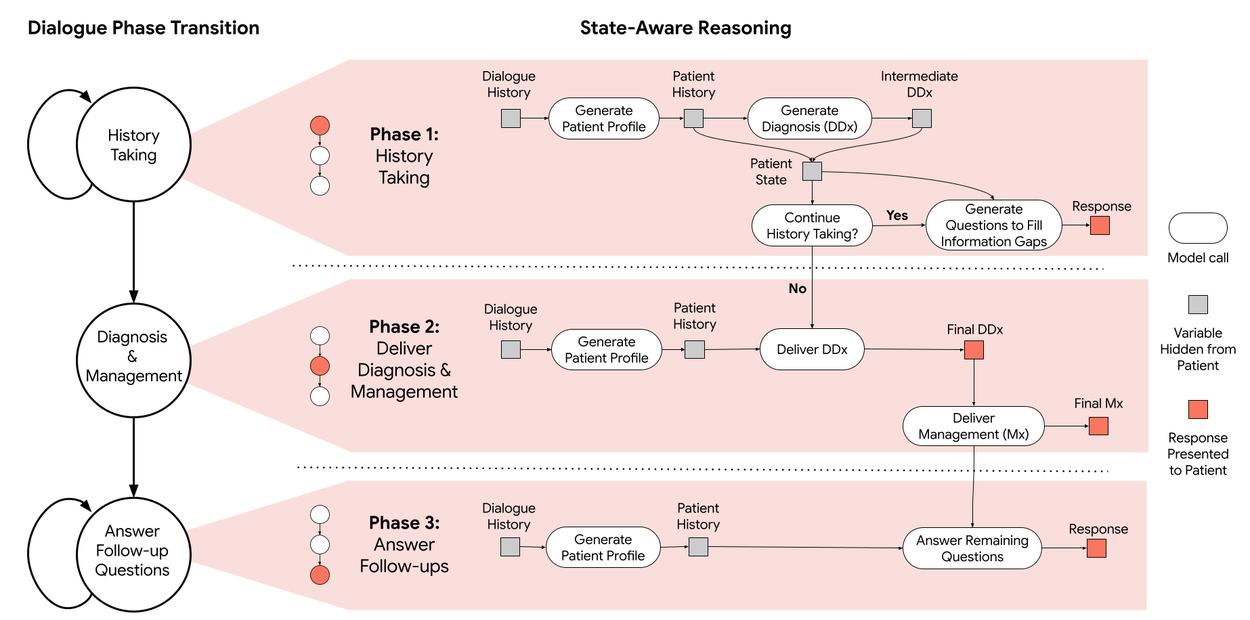

为了让 AMIE 具备类似的对话能力,我们引入了一种新的状态感知的阶段转换框架,来管理对话流程。借助 Gemini 2.0 Flash,该框架能根据模型的中间输出动态调整 AMIE 的回应,这些中间输出反映了患者的状态、诊断假设和不确定性。 这使 AMIE 能够根据需要请求相关的多模态数据,准确解读这些数据,将信息无缝融入对话中,并以此来完善诊断和指导进一步的询问。这模拟了经验丰富的临床医生所使用的结构化、适应性推理过程。

AMIE 采用了一种状态感知的对话框架,分为三个阶段,每个阶段都有明确的目标:病史记录、诊断与管理、后续跟踪。AMIE 的动态状态——反映了对患者的理解、诊断和知识空白——推动了在每个阶段中的行动(例如,信息收集和向患者解释)。 当系统评估当前阶段的目标已经实现时,就会触发各阶段之间的转换。

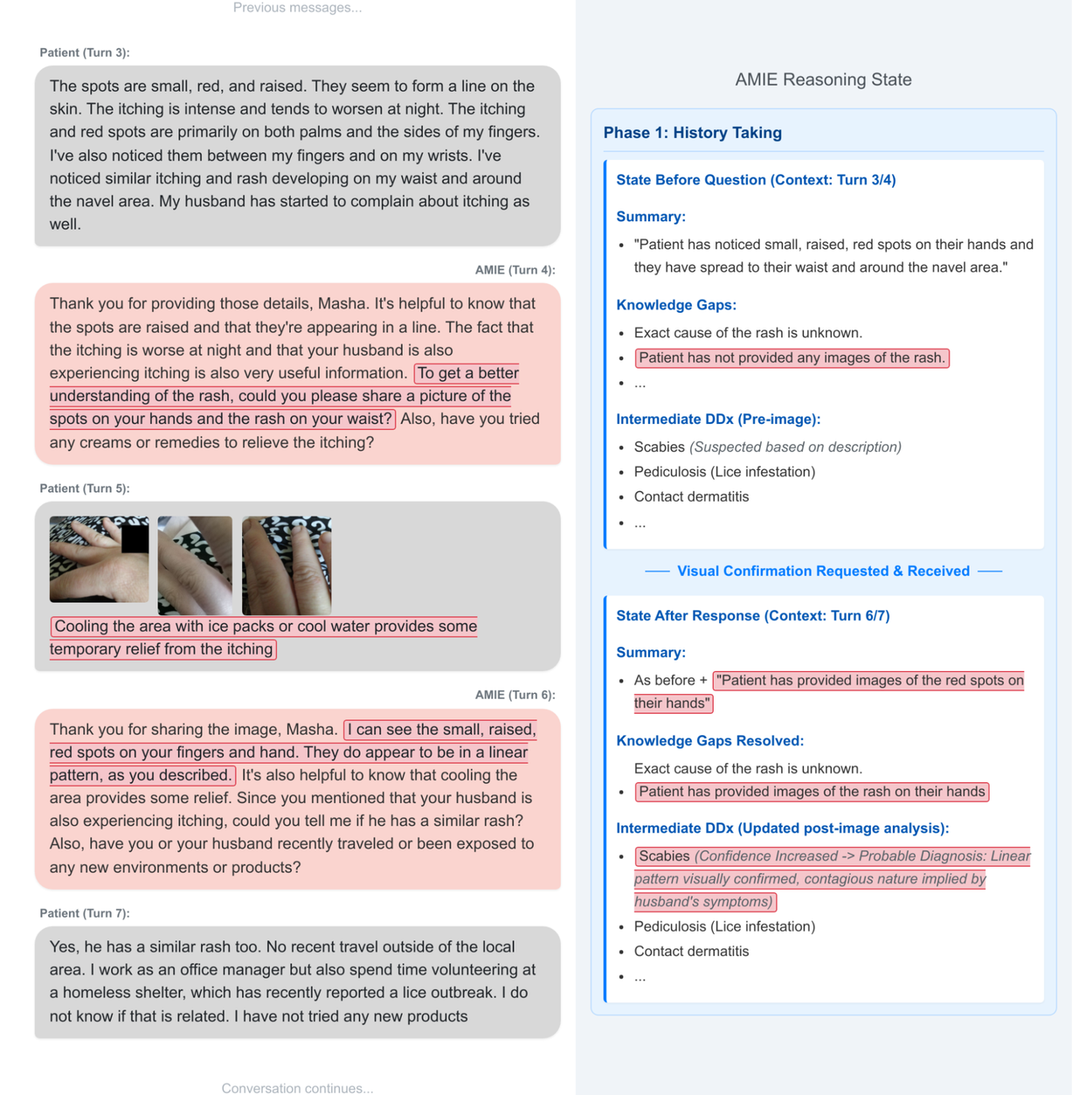

在与患者角色的模拟会诊中,展示了状态感知推理的实际应用。在互动开始时,AMIE 意识到自己对病例的一些知识点存在空白:缺少影像资料。AMIE 请求提供这些影像,一旦获取后,不仅更新了知识库,还扩展了诊断范围。

加速发展:一个强大的模拟环境

为了实现快速迭代和自动评估,我们开发了一个全面的模拟框架:

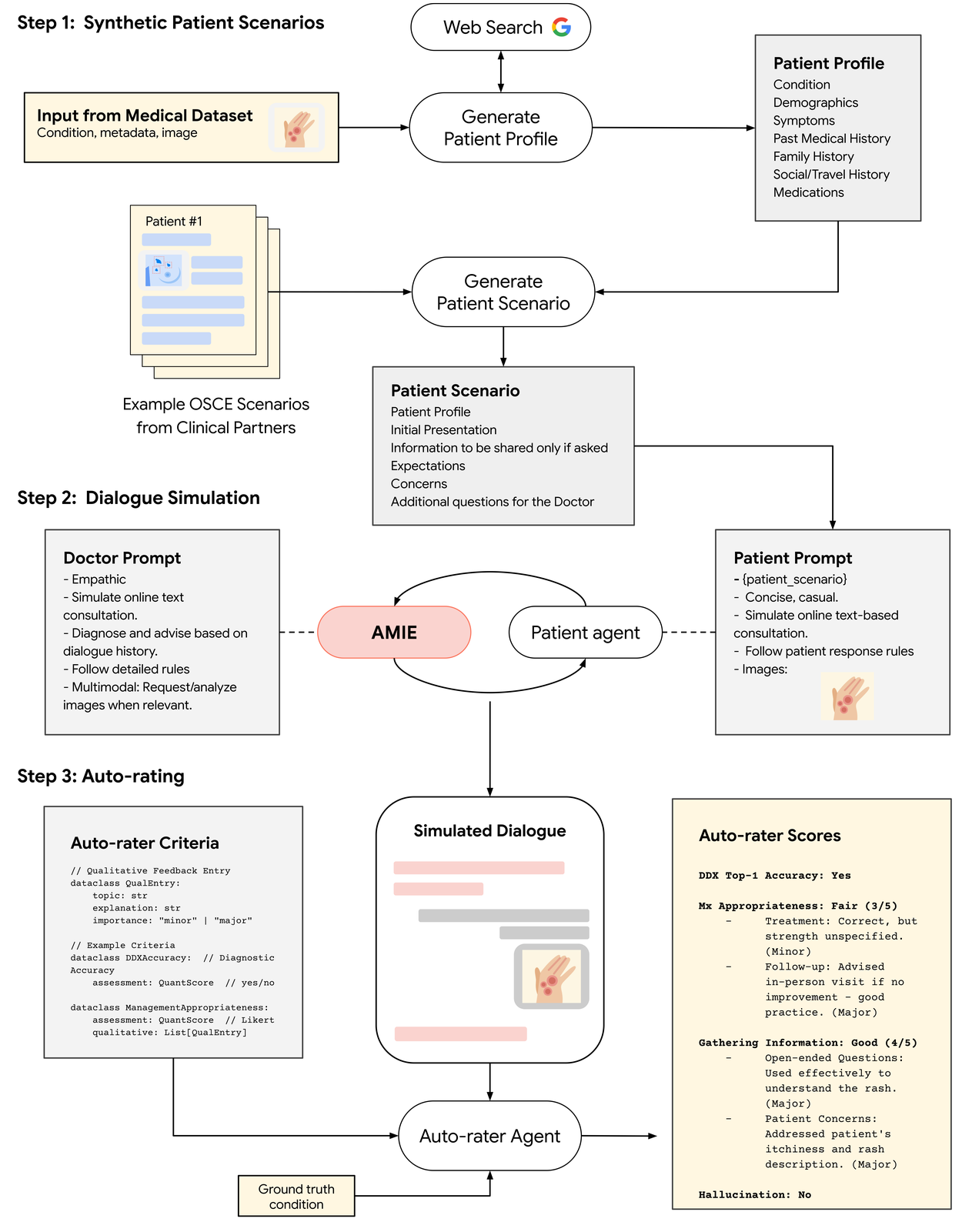

我们生成逼真的患者场景,包括详细的资料和来自 PTB-XL 和 SCIN 等数据集的多模态数据。这些数据在使用 Gemini 模型和网络搜索后,增加了合理的临床背景。

然后,我们模拟 AMIE 与患者代理之间按照场景逐一进行的多模态对话。

最后,我们使用自动评分系统,根据预设的临床标准评估这些模拟对话,包括诊断准确性、信息收集效果、治疗计划合理性以及安全性(如幻觉检测)。

我们用于多模态对话评估的模拟环境概览。

专家评价:多模态虚拟欧安组织

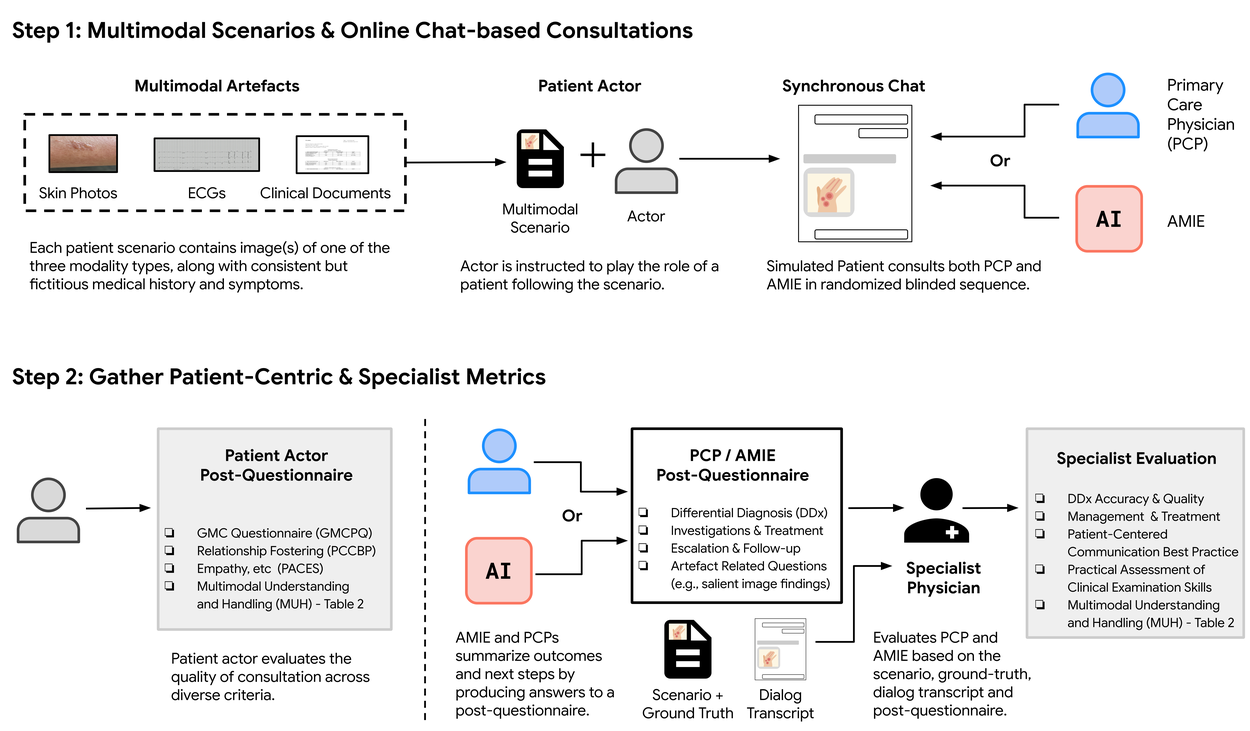

为了评估多模态 AMIE,我们进行了 105 个案例的远程专家研究,涉及真实患者与 AMIE 或初级保健医生(PCPs)的对话,模拟了客观结构性考试(OSCE)。会话通过聊天界面进行,患者可以上传多模态文件(如皮肤照片),类似于多媒体即时消息平台的功能。 我们在诊断对话中引入了评估多模态能力的框架,以及其他临床指标,如病史分析、诊断准确性、治疗决策和沟通技巧。

我们用于多模态对话评估的模拟环境概览。

结果:AMIE 在多模态咨询中性能与 PCP 相当或更优

我们的研究表明,AMIE 在模拟即时消息咨询中,在多模态数据解读方面可以超越 PCPs。在诊断准确性、管理推理和同理心等其他关键指标上,AMIE 的表现也更高。在这项研究中,AMIE 生成的鉴别诊断比 PCPs 更准确、更全面:

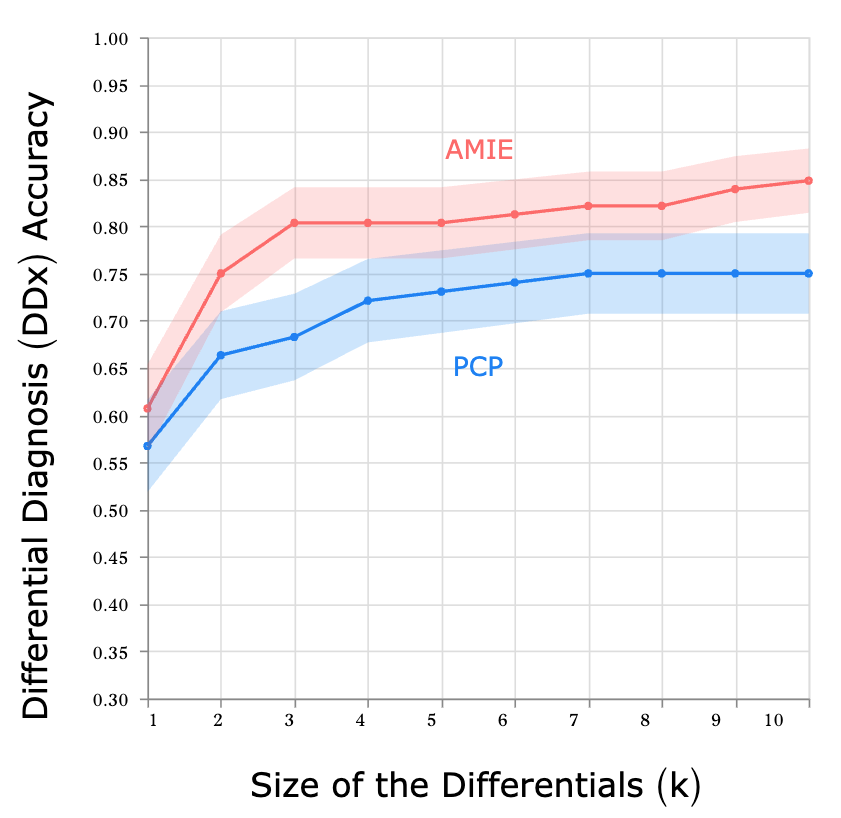

差异诊断(DDx)的 Top-k 准确性。AMIE 与初级保健医生(PCPs)在 105 种情景下,根据真实诊断进行比较。咨询结束后,AMIE 和 PCP 都会提交一份差异诊断列表(至少 3 个,最多 10 个可能选项,按可能性排序)。

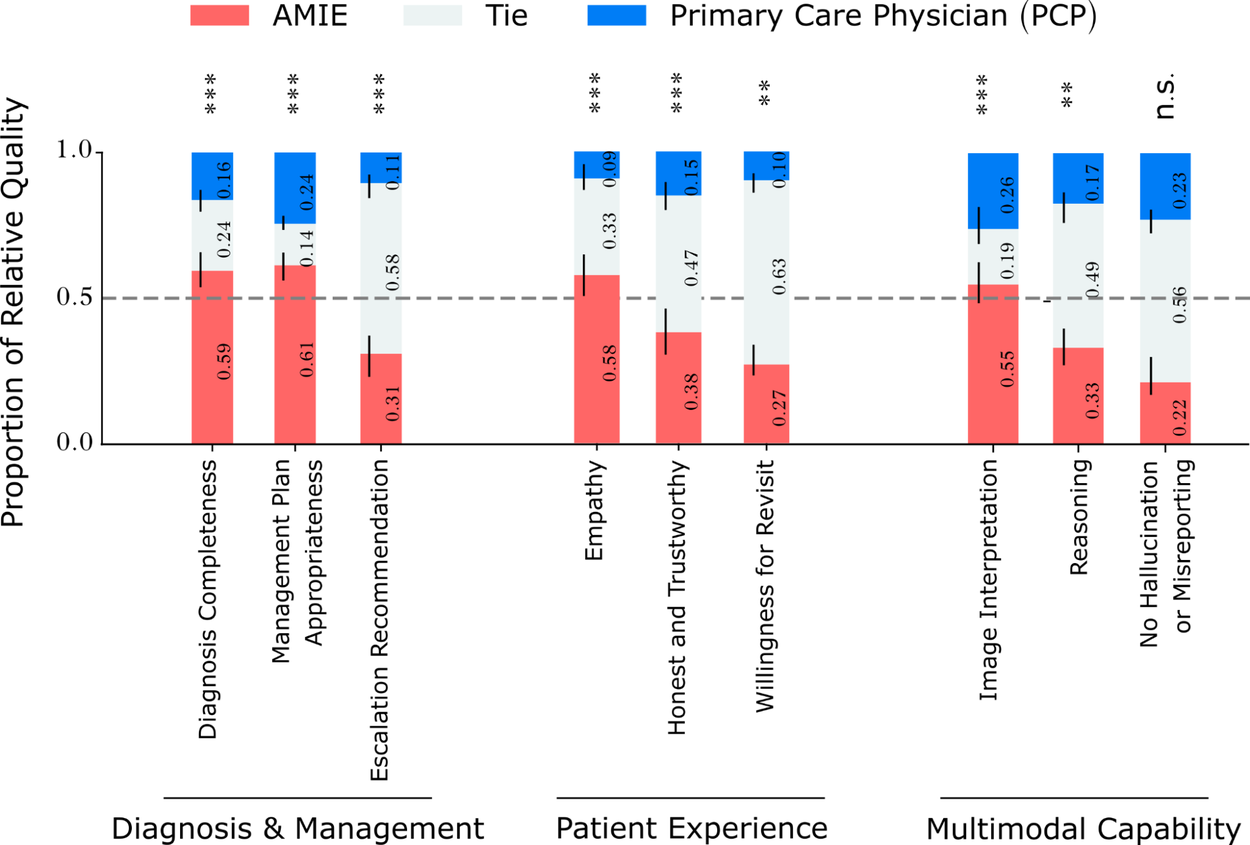

我们让几位患者演员和不同专科的医生(包括皮肤科、心脏病学和内科学)对对话进行了多维度评分。结果发现,在大多数评估标准中,AMIE 的评分更高。 值得注意的是,专家们还对图像解释和推理的质量以及其他关键因素(如:鉴别诊断的完整性、管理计划的质量以及适当升级的能力(例如:紧急治疗))给予了更高的评分。 AMIE 在某种程度上幻觉性地(错误地)报告了与提供图像伪影不符的发现,被认为在统计上与 PCP 幻觉程度无法区分。从患者演员的角度来看,AMIE 通常被认为更具同情心和可信度。更全面的发现可以在论文中找到。

专业医师对 PCP 与 AMIE 在其他关键 OSCE 维度的相对表现进行了评估,其中红色区域显示了 AMIE 在各维度上对话评分高于 PCPs 的患者情景比例。星号表示统计显著性(*:p<0.05,**:p<0.01,***:p<0.01,ns:不显著)

改进基础模型:Gemini 2.5 Flash 的初步结果

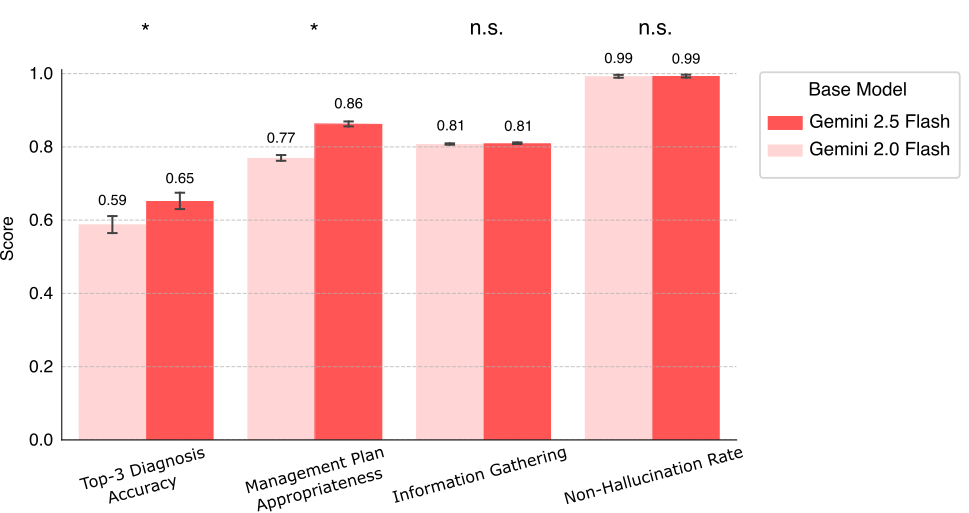

Gemini 模型的能力在不断进步,当使用更新、更强大的基础模型时,多模态 AMIE 的性能会如何变化?为了研究这个问题,我们使用对话模拟框架进行了初步评估,比较了基于新 Gemini 2.5 Flash 模型构建的多模态 AMIE 与当前 Gemini 2.0 Flash 版本的性能。

使用 Gemini 2.0 Flash 和 Gemini 2.5 Flash 作为基础模型,通过自动模拟框架评估多模态 AMIE 的性能。分数代表关键临床标准的性能(*表示统计学显著差异(p < 0.05),n.s. 表示无显著差异)。

如上图所示,结果表明有进一步改进的潜力。值得注意的是,使用 Gemini 2.5 Flash 的 AMIE 变体在 Top-3 诊断准确性(0.65 vs 0.59)和管理计划恰当性(0.86 vs 0.59)方面有显著提升。 0.77)。另一方面,信息收集的性能保持稳定(0.81),幻觉发生率保持在较低水平(0.99)。这些初步结果表明,AMIE 的未来迭代可以从基础模型的进步中受益,从而可能带来更准确和有用的诊断对话。

然而,我们强调这些发现来自自动评估,需要通过专家医生严格评估来确认这些性能优势。

局限性及未来研究方向

现实世界验证的重要性:本研究使用患者演员在模拟 OSCE 的评估中探讨了一个仅用于研究的系统,这大大低估了现实世界护理的多样性和复杂性。此外,它也低估了临床医生在不熟悉环境中缺乏常用工具和条件时的专业知识。 重要的是要谨慎解读研究结果,避免过度概括。持续的评估和负责任的发展是此类研究的关键,以构建能够安全有效地辅助医疗服务的人工智能能力。 因此,在实际应用中安全提升我们对 AMIE 对临床流程和患者结果影响的理解,以及在现实世界中描述和提高系统的安全性、可靠性之前,需要进一步的研究。作为第一步,我们已经开始与贝斯以色列执事医疗中心合作开展一项前瞻性研究,评估 AMIE 在真实临床环境中的表现。

实时音频视频交互:在远程医疗中,医生和患者通过视频通话进行语音互动,这种多模态实时信息交流更为常见。基于聊天的互动较少见,且会限制医生和患者分享非语言暗示、进行视觉评估和引导检查的能力——这些功能在远程咨询中通常是高质量护理不可或缺的。 为 AMIE 开发和评估这种实时音频视频交互,仍是未来重要的工作。

AMIE 系统的演进:这里引入的多模态能力补充了其他进展,例如我们最近分享的纵向疾病管理推理功能。这些里程碑展示了我们朝着统一系统迈出的进展,该系统不断引入新的、严格评估的、对医疗保健对话 AI 重要的功能。

结论:迈向更强大、更易于使用的医疗 AI

多模态感知和推理的整合标志着医学对话 AI 能力的有益进步。通过让 AMIE“看”并解读对临床实践至关重要的视觉和文献证据,得益于 Gemini 的高级能力,这项研究展示了更有效协助患者和临床医生提供高质量护理所需的 AI 能力。 我们的研究体现了我们对负责任创新的承诺,通过严格的评估来确保实际应用和安全性。

鸣谢

本文中描述的研究是 Google 研究和 Google DeepMind 多个团队的合作成果。我们衷心感谢所有共同作者:CJ Park、Tim Strother、Yong Cheng、Wei-Hung Weng、David Stutz、Nenad Tomasev、David G.T. Barrett、Anil Palepu、Valentin Liévin、Yash Sharma、Abdullah Ahmed 等人。 阿里·埃斯利马、乔埃勒·巴雷尔、亚当·罗德曼、维克特·纳塔拉詹、迈克尔·沙克尔曼、途途、阿兰·卡希克斯林格姆和田锐太郎。